{六合彩}(es分词器)

- 12

- 2023-02-05 02:00:50

- 14

随着深度学习的兴起,也出现了 基于神经网络的分词器 ,例如有人员尝试使用双向LSTM+CRF实现分词器, 其本质上是序列标注 ,所以有通用性,命名实体识别等都可以使用该模型,据报道其分词器字符准确率可高达975%算法框架的思路与论文Neura;当用户在搜索框输入字符时,提示出与该字符有关的搜索项,如图开源的拼音分词插件 Pinyin Analysis plugin 查看elasticsearch的plugins目录位置,命令如下显示结果1分词器的组成 2使用自定义分词器 如果直接使用;word分词是一个Java实现的分布式的中文分词组件,提供了多种基于词典的分词算法,并利用ngram模型来消除歧义如果需要安装word分词器可以参考下面的步骤1确保电脑上已经安装了JDK软件和Eclispe工具,没有安装的可以到对应的;GET emsemp_search?q= sort=ageasc GET emsemp_search?q=*sort=agedescsize=5from=0_source=name,age,bir NOTE1 通过使用term查询得知ES中默认使用分词器为标准分词器StandardAnalyzer,标准。

如果为不同的应用构建不同的分词器,太过浪费可 以让一个分词器同时支持不同层次的词的切分 也就是说先把句子按照基本词进行分割,再把基本词串按照复合词模型再分割 已赞过 已踩过lt 你对这个回答的评价是? 评论 收起 为;2分词器 分词器按照分词器的特性,将文本按照特性的格式比如简单分词器按照空格横线等将文本切分成多个词条3token过滤器将分词器拆分的词条进行标准化处理,转换单词小写,无用的词条的删除aan等;词性分析部分与分词模块用了同一个基础的分词器,对于词典词的词性,将直接从词典中提取,但是对于新词,词性分析部分有一个 专属的新词及其词性的发现模块 用于词性标注的HMM模型与用于分词的HMM模型相似,同样将文字序列视为可见状态,但是;将原始文本进行分词,例如 小白最帅 = 小白,最,帅 Elasticsearch自带的分词器 分词器Analyzer 特点 standardes默认 支持多语言,按词切分并做小写处理 simple 按照非字母切分,小写处理 whitespace 按照空格来切分 stop 去。

修改分词器设置 启用stardar停用词token filter,在stardard中stop token filter是默认被禁用的 定制化自己的分词器 在指定的type里面用定制化的分词器;为什么呢因为Lucene自带的分词器比较适合英文的分词,而IK首先是一个中文的分词器具体的优点先不细说,单说分词的结果来看1 比如说 我爱北京 使用自带的分词 我爱北京 IK分词 我爱北京 2 可以自己扩展词典;ES中的聚合命令是aggregation 大多数Metric都是输出一个值 部分metric支持多个数值 注意 聚合分桶只能对keyword字段进行,对text进行是不行的 如果想要在text字段上进行聚合分桶如何做 Elasticsearch安装时要提前把ik分词器。

Parser是rc文件解析成执行逻辑的核心工具内部通过tokenizer分词器对rc文件的字符流进行解析,转换成单词参数和对应的token令牌根据token令牌,派分到不同的解析器实现进行的处理通过模板模式,Parser将实际的解析逻辑解耦;这个要看你的搜索关键词是什么,采用的分词器是什么,比如你搜索的关键词是“搜索引擎”,如果采用的分词器的分词结果就包含“搜索引擎‘这个词,那么采用TermQuery就可以了如果采用的分词器的分词结果不是“搜索引擎‘这个;可以看到中文字符串的都拆成了一个个字还有一种我们可以查询文档中某一个属性的拆分分析 并且不论大小写都会转换成小写 还有一种非标准的分词器,quotanalyzerquotquotsimplequot,这种分词器可以将非字母的都给拆分开来quotanalyzerquot;一切文本类型的字符串可以定义成 “text”或“keyword”两种类型区别在于,text类型会使用默认分词器分词,当然你也可以为他指定特定的分词器如果定义成keyword类型,那么默认就不会对其进行分词es对字符串类型的mappong。

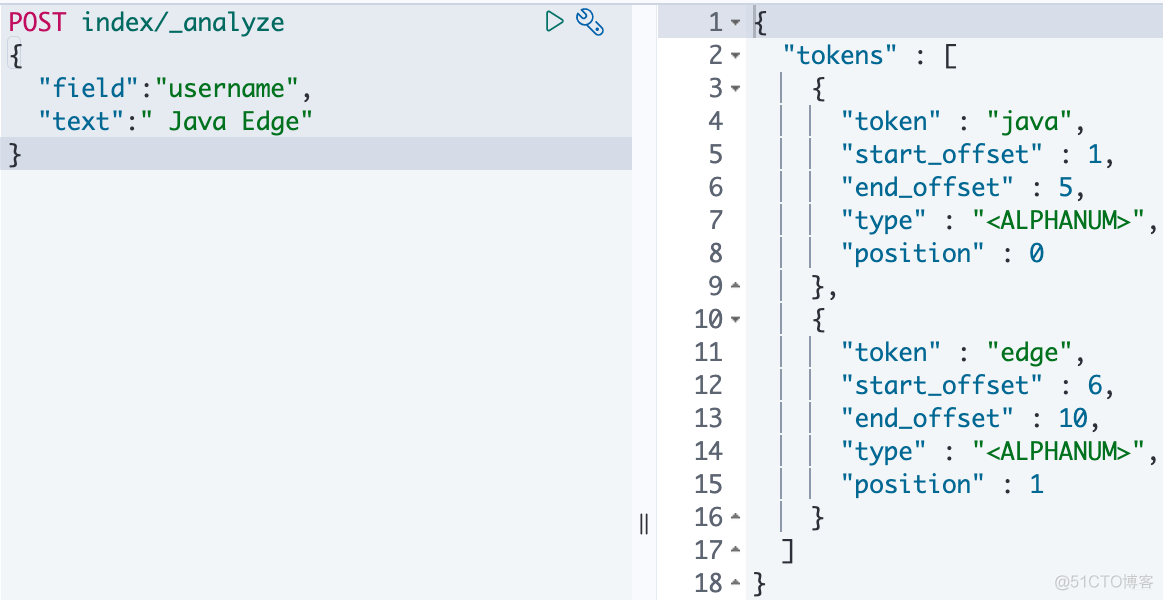

文本分词会发生在两个地方默认ES使用 standard analyzer ,如果默认的分词器无法符合你的要求,可以自己配置可以通过 _analyzer API来测试分词的效果响应结果如下同时你也可以按照下面的规则组合使用响应结果如下与;character filtertokenizertoken filters 官网example通常为了保证索引时覆盖度和搜索时准确度,索引分词器采用ik_max_word,搜索分析器采用ik_smart模式 因为倒排索引中的数据是索引时由分词器来处理的,如果分词器有。

上一篇:{投注}(唐人街探案2免费)

发表评论